Vídeo altera rostos de defensores para Tom Cruise e Brad Pitt usando deepfake, campanha contra golpes com IA demonstra como imagens e falas podem ser distorcidas na internet

Um vídeo publicado pela Defensoria Pública do Amazonas transformou defensores públicos nos atores Tom Cruise e Brad Pitt, em uma ação direta para mostrar os riscos dos golpes com IA.

A peça digital altera rostos e fala, e serve como demonstração prática de como a técnica chamada deepfake pode ser usada para enganar pessoas nas redes sociais.

As informações e exemplos foram divulgados pela Defensoria Pública do Amazonas, conforme informação divulgada pela Defensoria Pública do Amazonas.

O que o vídeo mostra

No material, defensores têm o rosto alterado digitalmente para os de atores conhecidos, e a legenda explica o objetivo, usando o próprio recurso que pode gerar fraudes como exemplo.

A publicação alerta, em suas palavras, “Nem tudo o que você vê na internet é verdade, Esse conteúdo que você viu é um exemplo de como é possível usar a inteligência artificial para distorcer imagens”, frase que aparece na legenda do vídeo.

O vídeo já contabiliza mais de 200 mil visualizações, e no final dois defensores aparecem com as fisionomias reais para reforçar o aviso ao público.

Quem participa e o alerta final

Ao fim da peça, os defensores Marcelo Pinheiro e Arlindo Gonçalves reaparecem com o rosto verdadeiro e reforçam o alerta sobre golpes com IA.

Como dito por Marcelo Pinheiro, “Qualquer pessoa com muita facilidade pode produzir vídeos que pareçam reais, mas não são”, uma chamada direta para atenção ao navegar na internet.

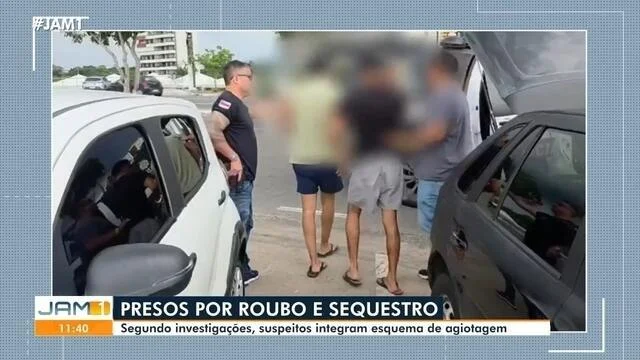

Como a deepfake facilita golpes com IA

A técnica denominada deepfake usa inteligência artificial para substituir rostos em fotos e vídeos, ou mesmo para alterar o áudio do que é dito, tornando a fraude mais crível para quem vê sem verificar a origem.

Golpes com IA exploram a confiança visual e podem ser usados para extorsão, fraudes financeiras, ou para espalhar desinformação, por isso entender o funcionamento é parte da prevenção.

Como se proteger de fraudes e identificar deepfakes

Verifique a fonte do vídeo, busque a publicação original, confira outros canais oficiais e desconfie de urgência ou pedidos de dinheiro e informações pessoais.

Atente para detalhes como sincronização labial, iluminação inconsistente e falhas no enquadramento, e use ferramentas de verificação quando possível, lembrando sempre, que golpes com IA podem parecer reais, mas nem sempre são.